-

Executando vários LLMs locais simultaneamente: Guia de configuração de vários modelos

Execute vários LLMs locais ao mesmo tempo para tarefas diferentes. Guia para orquestração de modelos, alocação de recursos e arquiteturas multimodelos. Continuar lendo Executando vários LLMs locais simultaneamente:…

-

Revisão de código de IA de auto-hospedagem: modelos locais para melhor qualidade de código

Configure um sistema automatizado de revisão de código usando LLMs locais. Detecte bugs, problemas de segurança e violações de estilo antes que cheguem à produção. Continuar lendo Revisão…

-

Comparação de ferramentas de codificação de IA 2026: Claude Code vs Cursor vs Copilot

Comparação abrangente dos principais assistentes de codificação de IA em 2026. Encontre a ferramenta perfeita para seu fluxo de trabalho de desenvolvimento. Continuar lendo Comparação de ferramentas de…

-

Executando Vários Modelos Locais: Estratégias de Gerenciamento de Memória

Aprenda como executar com eficiência vários modelos LLM simultaneamente em uma única GPU por meio de gerenciamento de memória e orquestração de modelos adequados. Continuar lendo Executando Vários…

-

Como ajustar LLMs locais em 2026: um guia prático

Aprenda como ajustar LLMs locais com base em seus próprios dados. Guia completo para LoRA, QLoRA e ajuste completo com ferramentas de código aberto. Continuar lendo Como ajustar…

-

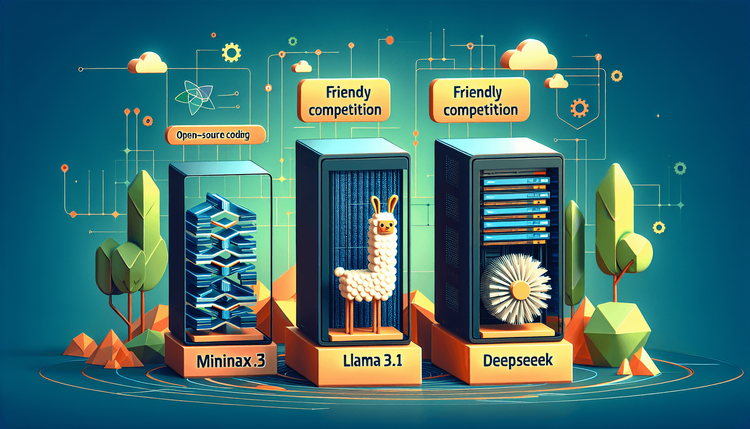

MiniMax 2.5 vs Llama 3.1 vs DeepSeek: referência de modelo de codificação local 2026

Comparamos três modelos líderes de codificação de código aberto em hardware local para determinar a melhor escolha para a produtividade do desenvolvedor. Continuar lendo MiniMax 2.5 vs Llama…

-

Custos de LLM auto-hospedado: guia completo de preços para 2026

Calcule o custo real dos LLMs auto-hospedados em 2026. Hardware, eletricidade, manutenção e comparação com alternativas de API. Continuar lendo Custos de LLM auto-hospedado: guia completo de preços…

-

Team Local AI: Compartilhando uma GPU entre vários desenvolvedores

Pare de comprar GPUs para todos. Veja como configurar uma infraestrutura de IA local compartilhada que atenda toda a sua equipe de engenharia a partir de uma única…

-

gstack: Instalando a configuração do código Claude de Garry Tan com um clique

Garry Tan acaba de lançar o gstack, uma ferramenta que permite instalar sua configuração exata de habilidade do Claude Code com um único comando. Veja como usá-lo e…

-

Práticas recomendadas de segurança local LLM para empresas em 2026

Proteja sua infraestrutura de IA com práticas de segurança de nível empresarial para implantações locais de LLM. Abrange autenticação, controle de acesso e isolamento de dados. Continuar lendo…