-

Custos de LLM auto-hospedado: guia completo de preços para 2026

Calcule o custo real dos LLMs auto-hospedados em 2026. Hardware, eletricidade, manutenção e comparação com alternativas de API. Continuar lendo Custos de LLM auto-hospedado: guia completo de preços…

-

Team Local AI: Compartilhando uma GPU entre vários desenvolvedores

Pare de comprar GPUs para todos. Veja como configurar uma infraestrutura de IA local compartilhada que atenda toda a sua equipe de engenharia a partir de uma única…

-

gstack: Instalando a configuração do código Claude de Garry Tan com um clique

Garry Tan acaba de lançar o gstack, uma ferramenta que permite instalar sua configuração exata de habilidade do Claude Code com um único comando. Veja como usá-lo e…

-

Práticas recomendadas de segurança local LLM para empresas em 2026

Proteja sua infraestrutura de IA com práticas de segurança de nível empresarial para implantações locais de LLM. Abrange autenticação, controle de acesso e isolamento de dados. Continuar lendo…

-

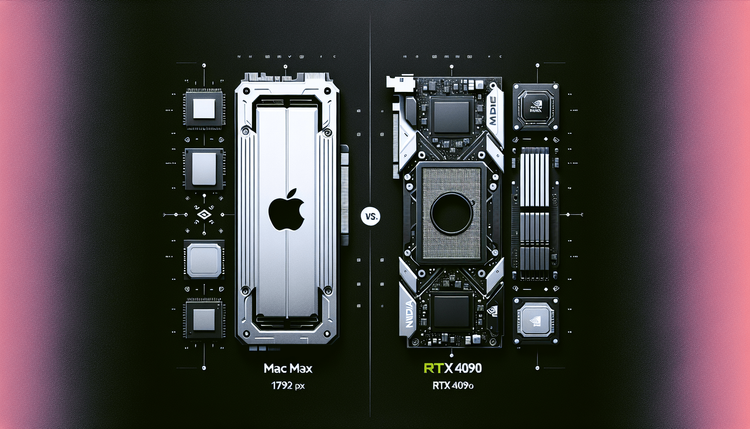

Mac M3 Max vs RTX 4090: Confronto de desempenho local LLM 2026

A memória unificada da Apple atende à VRAM dedicada da NVIDIA. Comparamos ambos para execução local do LLM para ajudá-lo a escolher o hardware certo. Continuar lendo Mac…

-

RAG local sem nuvem: configuração de IA de documentos privados

Crie um sistema de resposta a perguntas sobre seus próprios documentos usando modelos locais. Mantenha a privacidade dos seus dados enquanto aproveita a IA para recuperação de conhecimento.…

-

Executando LLMs locais no Apple Silicon Mac: Guia de otimização M1/M2/M3

Obtenha desempenho máximo de LLMs locais em seu Apple Silicon Mac. Guia completo de otimização para chips M1, M2 e M3. Continuar lendo Executando LLMs locais no Apple…

-

A configuração local de IA de US$ 1.500: DeepSeek-R1 em hardware de consumo

A execução de um modelo de raciocínio localmente não requer uma estação de trabalho de US$ 10.000. Veja como construir uma configuração DeepSeek-R1 capaz dentro do orçamento. Continuar…

-

Quantização explicada: Q4_K_M vs AWQ vs FP16 para LLMs locais

Compreender a quantização do modelo é crucial para executar LLMs localmente. Analisamos a matemática, as compensações e ajudamos você a escolher o formato certo para o seu hardware.…

-

Guia de configuração do Ollama: execute LLMs locais como um profissional em 2026

Domine Ollama em 2026 com este guia de configuração profissional. Configure modelos, otimize o desempenho e integre-o ao seu fluxo de trabalho de desenvolvimento. Continuar lendo Guia de…