-

Mac M3 Max vs RTX 4090: Confronto de desempenho local LLM 2026

A memória unificada da Apple atende à VRAM dedicada da NVIDIA. Nós comparamos ambos para execução local do LLM para ajudá-lo a escolher o hardware certo. Continuar lendo…

-

RAG local sem nuvem: configuração de IA de documentos privados

Crie um sistema de resposta a perguntas sobre seus próprios documentos usando modelos locais. Mantenha a privacidade dos seus dados enquanto aproveita a IA para recuperação de conhecimento.…

-

Team Local AI: Compartilhando uma GPU entre vários desenvolvedores

Pare de comprar GPUs para todos. Veja como configurar uma infraestrutura de IA local compartilhada que atenda toda a sua equipe de engenharia a partir de uma única…

-

MiniMax 2.5 vs Llama 3.1 vs DeepSeek: referência de modelo de codificação local 2026

Comparamos três modelos líderes de codificação de código aberto em hardware local para determinar a melhor escolha para a produtividade do desenvolvedor. Continuar lendo MiniMax 2.5 vs Llama…

-

Revisão de código de IA de auto-hospedagem: modelos locais para melhor qualidade de código

Configure um sistema automatizado de revisão de código usando LLMs locais. Detecte bugs, problemas de segurança e violações de estilo antes que cheguem à produção. Continuar lendo Revisão…

-

Executando Vários Modelos Locais: Estratégias de Gerenciamento de Memória

Aprenda como executar com eficiência vários modelos LLM simultaneamente em uma única GPU por meio de gerenciamento de memória e orquestração de modelos adequados. Continuar lendo Executando Vários…

-

OpenFANG: um sistema operacional de agente baseado em Rust que supera estruturas Python em escala

OpenFANG é um sistema operacional de agente pronto para produção construído em Rust com tempo de inicialização a frio de 180 ms, espaço de memória de 40 MB…

-

GitHub Copilot vs Claude Code: teste de precisão e velocidade

Os US$ 19/mês do GitHub Copilot valem a pena quando o Claude Code está disponível? Medimos a precisão da conclusão do código, a relevância das sugestões e a…

-

IDEs de IA comparados: Cursor, Claude Code e Cody em 2026

Três IDEs nativos de IA, três filosofias diferentes. Comparamos a abordagem agente do Cursor, o reconhecimento de contexto do Claude Code e a inteligência da base de código…

-

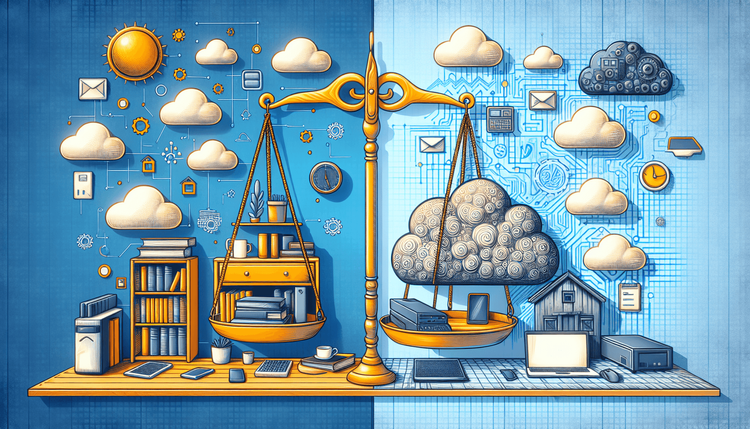

Codificação de IA local vs nuvem: análise de desempenho 2026

A execução de LLMs localmente para codificação agora é viável. Medimos a latência, o rendimento do token e as compensações de privacidade entre as configurações locais do Ollama/CodeLlama…