Um tutorial focado em hardware sobre como construir um servidor de inferência de IA dedicado usando componentes de consumo. Concentre-se no ponto ideal de dois RTX 3090s usados ou um único RTX 4090. Seções principais: 1. **Seleção de componentes:** Por que VRAM é rei. O conceito de ‘VRAM por dólar’. 2. **A Construção:** Notas de montagem física, requisitos de resfriamento para carga contínua. 3. **Configuração de BIOS e sistema operacional:** bifurcação PCIe, otimizações do servidor Ubuntu, configuração sem cabeça do driver NVIDIA. 4. **Particionamento de modelo:** Uso de paralelismo de tensor para dividir modelos 70B+ em placas de consumo. 5. **Custo versus nuvem:** cálculo de ROI mostrando o ponto de equilíbrio em relação aos custos da API GPT-4. **Estratégia de vinculação interna:** Vincule de volta ao Pilar. Link nativo para ‘Implantando LLMs locais no Kubernetes’ para as próximas etapas.

Continuar lendo

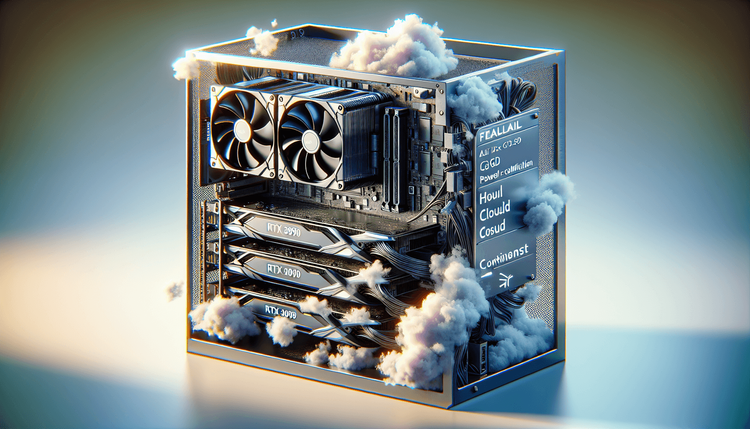

O servidor local de IA de US$ 1.500: DeepSeek-R1 em hardware de consumo

sobre SitePoint.